据80,000 Hours报道,谷歌DeepMind的联合创始人之一苏莱曼(Mustafa Suleyman)认为,AI几乎可以做任何领域的事,人类需要及时思考如何应对未来AI带来的一系列挑战。

苏莱曼对AI技术不断发展后的未来感到担忧,其与作家Michael Bhaskar合著的新书《即将到来的浪潮:技术、权力和21世纪最大的困境》(The Coming Wave:Technology,Power,and the 21st Century’s Greatest Dilemma)讲述了苏莱曼对未来感到担忧的原因,并提出了他想到的AI制衡计划,这个计划由10个部分组成。

一、AI制衡计划由10个部分组成,苏莱曼积极思考AI风险限制方法

在苏莱曼的新书《即将到来的浪潮:技术、权力和21世纪最大的困境》(后文简称:《即将到来的浪潮》)中,他提出了一个AI制衡计划,这个计划由10个部分组成,用来限制新兴技术带来负面影响和不可预见的后果。

该计划的10个部分为:第一,为AI技术安全制定计划;第二,对AI模型进行能力审核;第三,利用硬件瓶颈争取时间;第四,让批评AI功能的人直接参与设计AI模型;第五,让AI实验室以利润以外的动机为导向;第六,从根本上提高政府对AI的认识及其合理监管AI的能力;第七,制定国际条约来防止最危险的AI能力扩散;第八,在AI实验室中建立一种自我批判的文化并公开承认目前的AI发展状态是不可行的;第九,发起一场“了解AI并要求对AI进行必要控制”的大规模公众运动;第十,不去过分要求计算机的低延时,而是寻求进入一个新的、比较稳定的平衡状态。

▲Mustafa讲话

其中,苏莱曼认为加强监管才是真正改变现状的方式。他不认为一家公司能够应对偏离良性轨道发展的“错位”AI的威胁,公司不会把自己的模型作为应用程序编程接口(API)提供给其他人,让他们在上面生成新类型的内容,所以大多数时候公司都在努力不造成危害,但公司也不会积极参与发布新的审核工具或类似的东西。

苏莱曼认为OpenAI最近发布的用于审核的GPT-4非常好,AI初创公司Anthropic也做了很多类似的事情。苏莱曼说,目前Inflection只有40个人,一旦公司规模更大一点、更稳定一点,他们就会增加更多人来做审核的事情。

二、偏离良性轨道的AI,人类需要重视其巨大危险

2010年,苏莱曼与好友创建了DeepMind。2014年,DeepMind被谷歌收购,苏莱曼成为DeepMind应用AI主管。2019年,苏莱曼离开DeepMind项目,在谷歌总部担任AI产品和政策副总裁。2022年,苏莱曼离开谷歌,与职业社交平台领英(LinkedIn)创始人Reid Hoffman一同创立了AI公司Inflection。

如今,Inflection已经获得了超过10亿美元的投资,正在努力建造世界上最大的超级计算机之一来训练大语言模型。这个超级计算机的计算量是用于训练ChatGPT的超级计算机的10-100倍。

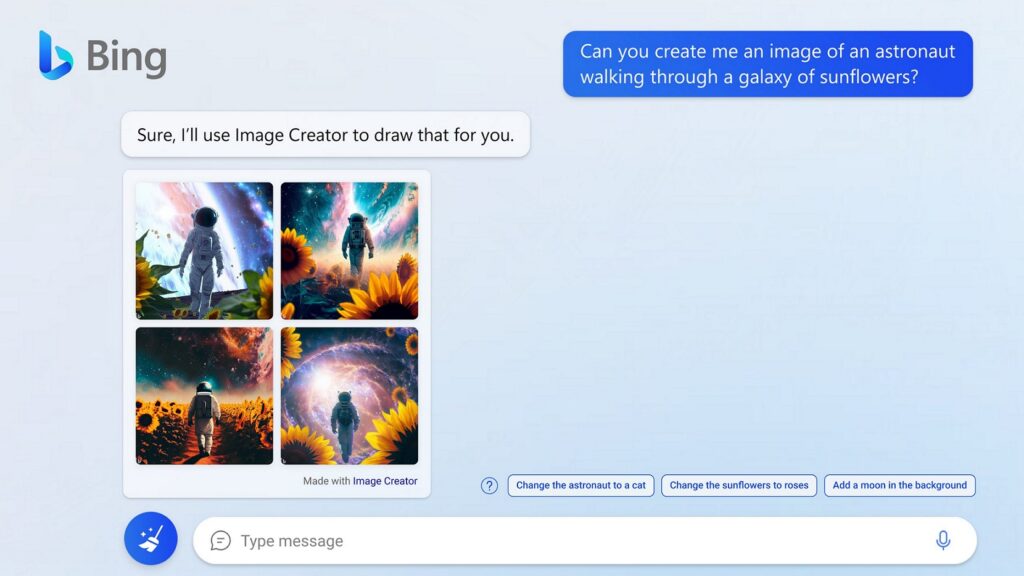

▲Inflection公司发布的首款AI产品Pi

尽管苏莱曼的公司Inflection在大力开发和训练比GPT-4更强大的大语言模型,但其实,苏莱曼对AI技术不断发展的未来充满担忧。苏莱曼在《即将到来的浪潮》中提到,未来可能真的很美好,但前提是我们能抓住AI发展问题的核心,并解决技术给我们带来的新问题。

根据苏莱曼所说的,AI和生物技术在不断发展后,很快就可能被不法分子利用,从而成为犯罪分子和恐怖分子的巨大帮手,让他们有能力以从前无法想象的规模来对社会造成伤害。另外,AI则很容易破坏目前社会状态的平衡,使我们向某个方向偏离,这十分危险。并且,AI和生物技术发展到最后,在我们的有生之年,人类可能不再需要为了生活而去工作,或者说,甚至没有去不去工作的选择,大家都失去了工作。这些是苏莱曼提到的人类未来可能面临的挑战。

在苏莱曼看来,“错位”的AI在未来几年内不会出现问题,但在未来,比如八年、十年或者是二年后,“错位”的AI会给人类带来挑战将成为一个完全合理的问题,我们需要现在开始未雨绸缪,应该有更多的人来研究它。

结语:AI未来风险需重视,加强监管或是重点

苏莱曼作为在AI领域研究多年并成果丰富的厉害人物,认为人类需要及时思考如何应对未来AI带来的一系列挑战。

苏莱曼在其新书《即将到来的浪潮》提出了AI制衡计划,并认为加强监管才是真正改变现状的方式。他十分关注其它AI公司在利用模型加强审核方面的尝试,其创立的Inflection也将在审核上继续努力。

未来,AI公司和政府将如何应对“错位”AI问题,我们将持续关注。

非特殊说明,本博所有文章均为博主原创。

如若转载,请注明出处:https://www.zerotech.cc/589.html

![[下载] 微软版轻量级PS?微软更新画图应用 增加图层和透明度支持 [下载] 微软版轻量级PS?微软更新画图应用 增加图层和透明度支持](https://www.zerotech.cc/wp-content/uploads/2023/09/8343183e545d317c7dc25972c299ac-1024x754.png)